AI大模型利好传来。

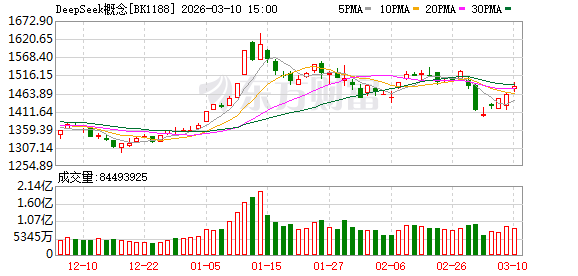

上周五(3月6日),万得DeepSeek概念指数尾盘拉升,从开盘时的小幅下跌到收涨1.87%。从概念股来看,拓维信息强势涨停,每日互动涨超5%,优刻得-W涨4.5%。

AI智能体OpenClaw爆火

10余家公司率先部署

拓维信息、优刻得-W的大涨或与最近爆火的AI Agent(AI智能体)OpenClaw(原名“Clawdbot”)有关。

就在上周五,近千名开发者与AI爱好者来到腾讯大厦,在腾讯云工程师的协助下,完成了OpenClaw的云端安装。据腾讯云方面介绍,本次活动通过腾讯轻量云Lighthouse一键部署,仅需5分钟即可免费安装,极大降低了难度。

公开报道显示,据美团数据,截至目前,“OpenClaw”相关搜索量环比增长超3倍。美团联合联想百应推出OpenClaw远程部署服务,消费者可在美团App搜索“龙虾安装”直达服务页面。

被业内称作“小龙虾”的OpenClaw,并非传统水产,而是近期热度极高的开源AI智能体(AI Agent),主打“接管电脑、解放双手”的自动化执行能力。

深圳市龙岗区人工智能(机器人)署近日就《深圳市龙岗区支持OpenClaw&OPC发展的若干措施(征求意见稿)》公开征询意见。其中提出,鼓励市场化、专业化平台载体推出“龙虾服务区”,免费提供OpenClaw部署服务,符合条件的给予一定补贴;提供OpenClaw类智能体工具开发推广支持。对向国际主流社区贡献关键代码、在技能交易平台开发上架龙岗优势产业相关技能包、开发与具身智能设备结合的应用项目的,经认定后给予最高200万元补贴等等。

东吴证券指出,以OpenClaw为代表的新一代AI Agent,已完成从“问答工具”向“可落地执行的实干助手”的本质跃迁,能够深度嵌入业务工作流、适配多场景应用,为投研、办公等场景带来颠覆性效率提升。在业内看来,OpenClaw的崛起推动AI迈入智能体的新时代。

从A股市场来看,根据公开披露的信息显示,目前已有10余家公司部署OpenClaw或完成OpenClaw适配对接。

以3月5日的融资余额与2025年年末变动情况来看,这10余家公司中,3家公司融资余额增幅超过30%,分别是优刻得-W、北信源、龙芯中科。

另外,顺网科技、拓维信息、科大讯飞、青云科技-U的融资余额增幅也均超过10%。

优刻得-W表示,公司1月下旬率先推出了部署OpenClaw的相关镜像,为行业内率先实现云端部署的厂商。

北信源自主研发的信源密信产品已完成OpenClaw适配对接。

龙芯中科表示,基于纯国产龙芯3B6000M芯片的硬件设备,成功完成了热门AI智能体OpenClaw的本地化部署。

此外,网络安全风险问题也值得重视。近期,工业和信息化部网络安全威胁和漏洞信息共享平台监测发现OpenClaw开源AI智能体部分实例在默认或不当配置情况下存在较高安全风险,极易引发网络攻击、信息泄露等安全问题。

建议相关单位和用户在部署和应用OpenClaw时,充分核查公网暴露情况、权限配置及凭证管理情况,关闭不必要的公网访问,完善身份认证、访问控制、数据加密和安全审计等安全机制,并持续关注官方安全公告和加固建议,防范潜在网络安全风险。

DeepSeek即将发布重磅大模型

DeepSeek大模型也有新消息。据媒体报道,DeepSeek将发布其最新的大模型V4,原生支持图片、视频与文本生成功能。这是DeepSeek自2025年1月推出R1推理模型以来的首个重大版本更新,大模型V4有望进一步填补国内低成本、开源模型的市场需求。

自2025年年初发布R1以来,DeepSeek在全球树立了开源模型的典范,其一直保持着稳定的更新迭代频次,并多次在国际权威期刊发表论文,公开大模型推理等领域的重要研究成果。

2025年9月,DeepSeek正式发布V3.2-Exp模型,在V3.1-Terminus的基础上引入了DeepSeek Sparse Attention(一种稀疏注意力机制),针对长文本的训练和推理效率进行了探索性的优化和验证。

2025年12月,公司发布DeepSeek-V3.2和DeepSeek-V3.2-Speciale。其中,DeepSeek-V3.2 的目标是平衡推理能力与输出长度,适合日常使用,DeepSeek-V3.2-Speciale 的目标是将开源模型的推理能力推向极致,探索模型能力的边界。

今年1月27日,DeepSeek正式发布新一代文档识别模型 DeepSeek-OCR2,该版本实现OCR领域突破,核心创新在于首创“因果流(Causal Flow)”视觉推理逻辑。

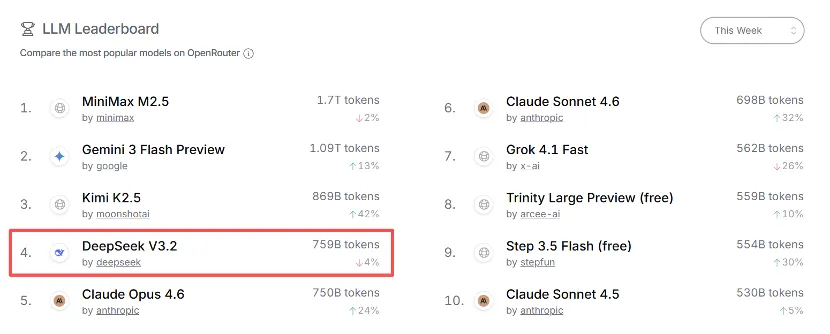

目前,全球最大的大模型API聚合平台OpenRouter数据显示,DeepSeek V3.2稳居Token消耗量前十阵营。此前记者在《Token出海或迎风口!Kimi+DeepSeek+智谱+MiniMax,筹码集中概念股出炉》中写道,今年2月DeepSeek的Token消耗量达到3万亿,位居大模型第4位。

还没有评论,来说两句吧...